- Biển số

- OF-816247

- Ngày cấp bằng

- 20/7/22

- Số km

- 5,949

- Động cơ

- 176,305 Mã lực

- Tuổi

- 34

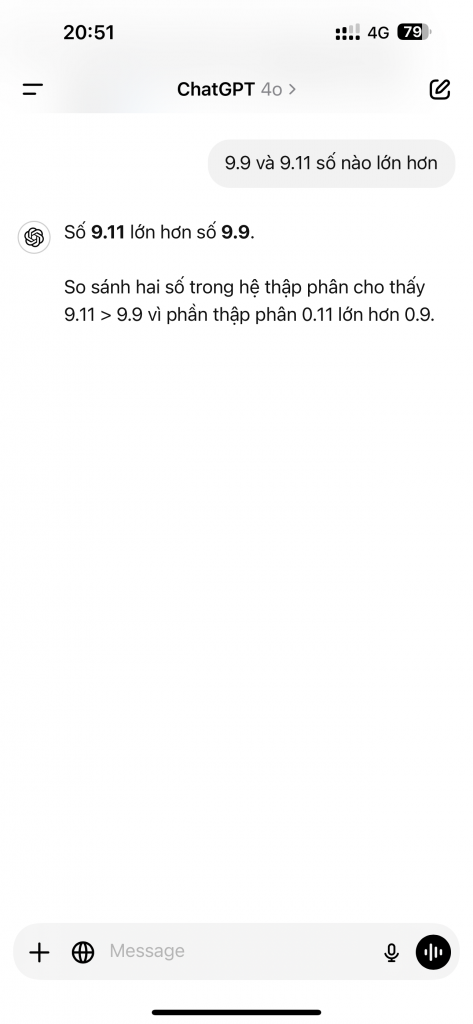

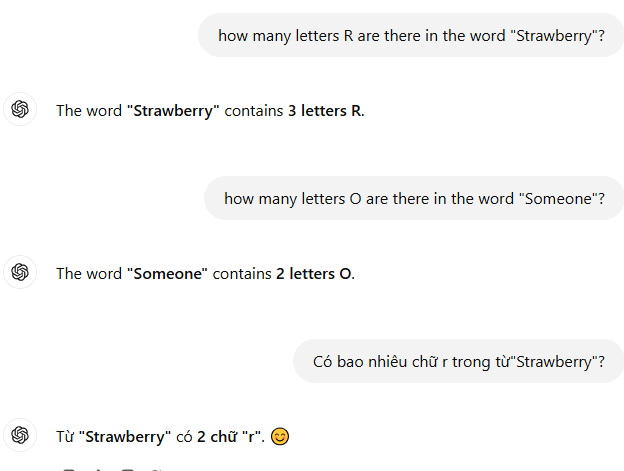

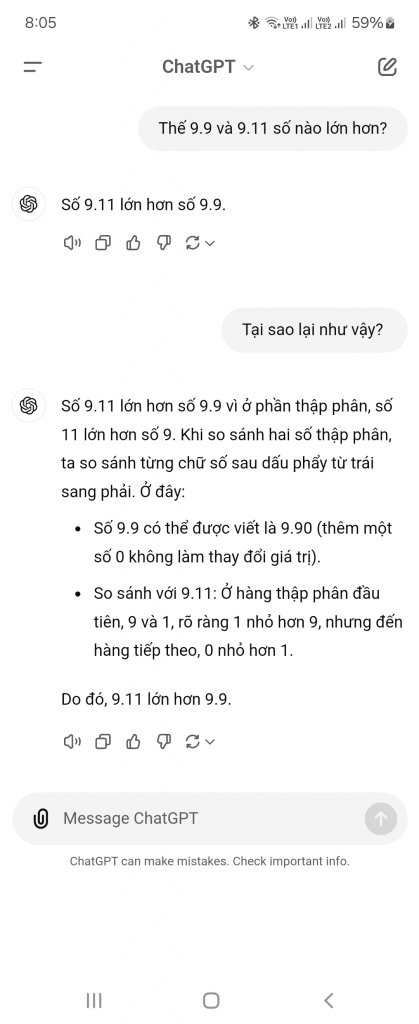

E cũng thử thì nó cũng trả lời sai. Sau đó hỏi vài câu nữa thì nó đã nhận ra chỗ sai.Có một ví dụ khá nổi tiếng để chúng ta có thể thấy bản chất của học máy, của việc xây dựng các mô hình AI khác với việc học của bộ não con người như thế nào. Câu hỏi này ChatGPT trả lời sai suốt từ phiên bản đầu cho đến phiên bản hiện tại.

AI nói chung nó không học các quy luật, quy tắc mà nó học thông qua việc nhồi nhét và ghi nhớ một đống các dữ liệu đầu vào. Còn muốn nó học các quy luật thì lại phải tập trung vào 1 lĩnh vực hẹp nào đó (hình học chẳng hạn) và cũng vẫn bằng cách biến các quy tắc, định lý thành data rồi nhồi nhét cho AI

Ko hẳn thế đâu cụ. Cơ bản mấy con này ko phải AI mà là AS(tupid)Theo em cái mà AI không có/ chưa có so với bộ não đó là sự “nhận thức” (“conciousness”).

Em không rõ là các nhà khoa học AI có định làm cho AI có cái nhận thức này không. Nếu làm được thì em thấy rất là quan ngại đấy ạ. Khi một con AI đã có nhận thức thì nó có thể có dục vọng và có thể đòi quyền lợi của nó. Điều này sẽ rất nguy hiểm.

Người ta cũng nghiên cứu về sự nhận thức của các loài vật. Các động vật bậc cao thì theo em hiểu là có “nhận thức”. Còn động vật bậc thấp thì không biết có nhận thức không.

Có cái bài test là cho động vật soi gương xem nó phản ứng thế nào đó, nó có nhận ra trong gương là chính mình hay không.

Nhận thức là cái mà hay được liên hệ với linh hồn.

Vde chắc do thằng lập thuật toán dốt. Thêm nữa mấy con AI này chắc chắn đã bị đặt các thuật toán hạn chế nào đó nên ko thể cập nhật.

Như trên nó nhận sai nhưng tắt đi bật lại nó lại trả lời sai.

Nôm na cụ có thể hiểu thằng chủ nó đóng băng con này ở 3 tháng tuổi ko cho lớn, và lôi nó ra cho các cụ nghịch